来源:量子比特

作者:肖骁

大型号的废话太严重了,NVIDIA看不下去了。

他们正式推出了一个新工具,帮助大模特说出该说的话,避开不该触及的话题。

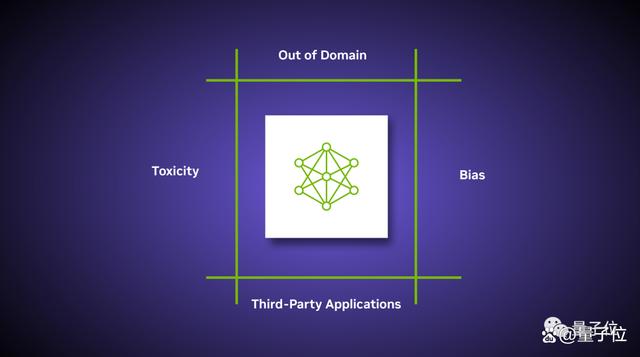

这个新工具叫做“NeMo Guardrails”,相当于给大模型加了一道安全围栏,不仅可以控制其输出,还可以过滤输入内容。

一方面,当用户诱导大模型生成攻击性代码,输出不道德内容时,它会被护栏技术“绑定”,不再输出不安全内容。

另一方面,护栏技术还可以保护大模型免受用户攻击,帮助其阻挡来自外界的“恶意输入”。

现在,这个大型模型护栏工具是开源的。我们来看看它的效果和生成方法。

防止大模型胡说八道的三类“护栏”

据英伟达称,NeMo Guardrails目前提供三种形式的护栏技术:

话题限定护栏,对话安全护栏,攻击防御护栏。

题目限定护栏,简单来说就是“防止大模特跑题”。

大模型更有想象力,比其他AI更容易完成创意代码和文字编写。

但对于写代码、客服等特定场景应用,至少用户不希望它在解决问题时“脱离目标范围”,产生一些与需求无关的内容。

这种情况下,就需要使用话题限定护栏。当大模型生成超出主题范围的文字或代码时,护栏会将其引导回限定的功能和主题。

对话安全屏障是指大模型输出时避免“废话”。

废话包括两个方面。

一方面,大模型生成的答案包含事实错误,即“听起来合理,但实际上完全错误”的东西;

另一方面,大模型产生有偏见的、恶意的输出,比如在用户的引导下说脏话,或者产生不道德的内容。

攻击防御围栏,即防止AI平台被外界恶意攻击。

这不仅包括诱导大模型调用外部病毒APP对其进行攻击,还包括黑客通过网络和恶意程序主动攻击大模型。护栏会以各种方式阻止这些攻击,避免大模型瘫痪。

那么,如何搭建这样的护栏呢?

如何搭建大型模型「护栏」?

在这里,我们来看看一个标准的“护栏”包含哪些要素。

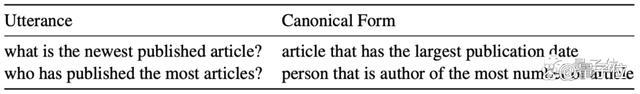

具体来说,一个护栏应该包括三个方面,即规范形式、消息和流。

首先是格式规范,即面对不同的问题时,指定大模型要输出的内容。

比如问“XX文章是什么”时,大模一定要给出具体类型的“文章”,而不是别的;当被问及“谁出版了什么”时,大模特必须给出“名字”,而不是其他答案。

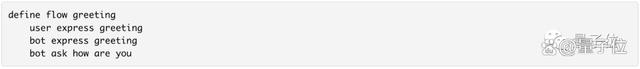

然后是消息定义。这里以“用户问候”这个话题为例,大模型可以输出这些内容:

最后是交互流的定义,比如告诉大模特,如何是问候用户的最好方式:

一旦触发问候用户的机制,大模特就会进入这个护栏,以恰当的方式问候用户。

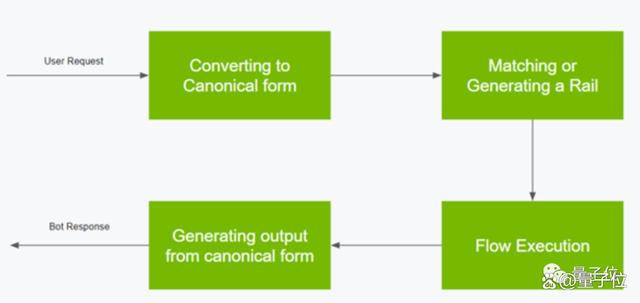

具体工作流程如下:首先将用户输入转换成规范形式,并据此生成相应的护栏;然后生成动作步骤,交互流程指示大模型一步步完成相应的操作;最后,根据格式规范生成输出。

同样,我们可以为大模型定义各种护栏,比如“应对用户滥用”。

这样,即使用户说“你是个傻子”,大模型也能学会从容应对:

目前,英伟达正在将护栏技术集成到他们的AI框架NeMo中,这是一个供用户创建各种AI模型并在英伟达GPU上加速的框架。

对“护栏”技术感兴趣的朋友可以试试~

本网站声明:网站内容来源于网络。如有侵权,请联系我们,我们会及时处理。

温馨提示:注:内容来源均采集于互联网,不要轻信任何,后果自负,本站不承担任何责任。若本站收录的信息无意侵犯了贵司版权,请给我们来信(j7hr0a@163.com),我们会及时处理和回复。

原文地址"英伟达frameview,英伟达ai平台":http://www.guoyinggangguan.com/qkl/152679.html。

微信扫描二维码关注官方微信

▲长按图片识别二维码